ĪĪĪĪėóéź▀_(d©ó)ė┌ 8 į┬ 21 ╚š░l(f©Ī)▓╝▓®╬─Ż¼░l(f©Ī)▓╝┴╦ Mistral-NeMo-Minitron 8B ąĪšZčį AI ─Żą═Ż¼Š▀éõŠ½Č╚Ė▀Īóėŗ╦Ńą¦┬╩Ė▀Ą╚ā×(y©Łu)³cŻ¼┐╔į┌ GPU ╝ė╦┘Ą─öĄ(sh©┤)ō■(j©┤)ųąą─ĪóįŲ║═╣żū„šŠ╔Ž▀\ąą─Żą═ĪŻ

ĪĪĪĪėóéź▀_(d©ó)öy╩ų Mistral AI ╔Žį┬░l(f©Ī)▓╝ķ_į┤ Mistral NeMo 12B ─Żą═Ż¼į┌┤╦╗∙ĄA(ch©│)╔Žėóéź▀_(d©ó)į┘┤╬═Ų│÷Ė³ąĪĄ─ Mistral-NeMo-Minitron 8B ─Żą═Ż¼╣▓ 80 ā|éĆģóöĄ(sh©┤)Ż¼┐╔ęįį┌┤Ņ▌dėóéź▀_(d©ó) RTX ’@┐©Ą─╣żū„šŠ╔Ž▀\ąąĪŻ

ĪĪĪĪėóéź▀_(d©ó)▒Ē╩Š═©▀^īÆČ╚╝¶ų”(width-pruning)Mistral NeMo 12BŻ¼▓óų¬ūRš¶s(knowledge distillation)▌pČ╚ųžą┬ė¢(x©┤n)ŠÜ║¾½@Ą├ Mistral-NeMo-Minitron 8BŻ¼ŽÓĻP(gu©Īn)│╔╣¹░l(f©Ī)▒Ēį┌ĪČCompact Language Models via Pruning and Knowledge DistillationĪĘšō╬─ųąĪŻ

ĪĪĪĪ╝¶ų”═©▀^╚ź│²ī”£╩(zh©│n)┤_┬╩žĢ½I(xi©żn)ūŅąĪĄ──Żą═ÖÓ(qu©ón)ųžüĒ┐sąĪ╔±Įø(j©®ng)ŠW(w©Żng)Įj(lu©░)ĪŻį┌ "š¶s" ▀^│╠ųąŻ¼čąŠ┐ąĪĮMį┌ę╗éĆąĪą═öĄ(sh©┤)ō■(j©┤)╝»╔Žųžą┬ė¢(x©┤n)ŠÜ╝¶ų”║¾Ą──Żą═Ż¼ęį’@ų°╠ßĖ▀═©▀^╝¶ų”▀^│╠Č°ĮĄĄ═Ą─£╩(zh©│n)┤_┬╩ĪŻ

ĪĪĪĪŠ═ŲõęÄ(gu©®)─ŻČ°čįŻ¼Mistral-NeMo-Minitron 8B į┌šZčį─Żą═Ą─Š┼ĒŚ┴„ąą╗∙£╩(zh©│n)£yįćųą▀b▀bŅI(l©½ng)Ž╚ĪŻ▀@ą®╗∙£╩(zh©│n)║Ł╔w┴╦Ė„ĘN╚╬äš(w©┤)Ż¼░³└©šZčį└ĒĮŌĪó│ŻūR═Ų└ĒĪóöĄ(sh©┤)īW(xu©”)═Ų└ĒĪó┐éĮY(ji©”)ĪóŠÄ┤a║═╔·│╔šµīŹ┤░ĖĄ──▄┴”ĪŻĖĮ╔ŽŽÓĻP(gu©Īn)£yįćĮY(ji©”)╣¹╚ńŽ┬Ż║

ĪĪĪĪģó┐╝

ĪĪĪĪLightweight Champ: NVIDIA Releases Small Language Model With State-of-the-Art Accuracy

ĪĪĪĪMistral-NeMo-Minitron 8B Foundation Model Delivers Unparalleled Accuracy

ĪĪĪĪCompact Language Models via Pruning and Knowledge Distillation

ĪĪĪĪ╬─š┬ā╚(n©©i)╚▌āH╣®ķåūxŻ¼▓╗śŗ(g©░u)│╔═Č┘YĮ©ūhŻ¼šłųö(j©½n)╔„ī”┤²ĪŻ═Č┘Yš▀ō■(j©┤)┤╦▓┘ū„Ż¼’L(f©źng)ļUūįō·(d©Īn)ĪŻ

║Żł¾╔·│╔ųą...

║Ż╦ćAIĄ──Żą═ŽĄĮy(t©»ng)į┌ć°ļH╩ął÷╔ŽÅV╩▄║├įuŻ¼─┐Ū░šŠā╚(n©©i)└█ėŗ─Żą═öĄ(sh©┤)│¼▀^80╚féĆŻ¼║Ł╔wīæīŹĪóČ■┤╬į¬Īó▓Õ«ŗĪóįO(sh©©)ėŗĪóözė░Īó’L(f©źng)Ė±╗»łDŽ±Ą╚ČÓŅÉą═æ¬(y©®ng)ė├ł÷Š░Ż¼╗∙▒ŠĖ▓╔w╦∙ėąų„┴„äō(chu©żng)ū„’L(f©źng)Ė±ĪŻ

9į┬9╚šŻ¼ć°ļHÖÓ(qu©ón)═■╩ął÷š{(di©żo)čąÖC(j©®)śŗ(g©░u)ėóĖ╗┬³(Omdia)░l(f©Ī)▓╝┴╦ĪČųąć°AIįŲ╩ął÷Ż¼1H25ĪĘł¾ĖµĪŻųąć°AIįŲ╩ął÷░ó└’įŲš╝▒╚8%╬╗┴ąĄ┌ę╗ĪŻ

9į┬24╚šŻ¼╚A×ķ└żņ`š┘ķ_Ī░ųŪ─▄¾w“ׯ¼ę╗Ų┴ĄĮ╬╗Ī▒╚A×ķIdeaHubŪ¦ąą░┘śI(y©©)¾w“×╣┘ėŗäØ░l(f©Ī)▓╝Ģ■ĪŻ

č┼±R╣■ū“╚šą¹▓╝═Ų│÷ā╔┐ŅŅ^┤„╩ĮČ·ÖC(j©®)Ż¼Ęųäe╩ŪŲĮ░Õš±─żĄ─YH-4000║═äė╚”įŁ└ĒĄ─YH-C3000ĪŻ

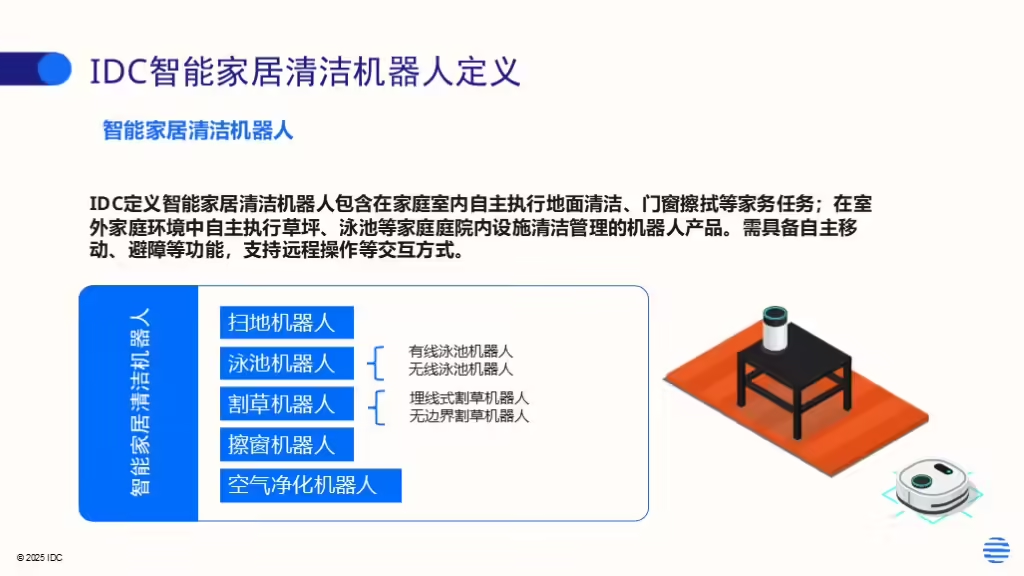

IDCĮ±╚š░l(f©Ī)▓╝Ą─ĪČ╚½Ū“ųŪ─▄╝ęŠėŪÕØŹÖC(j©®)Ų„╚╦įO(sh©©)éõ╩ął÷╝ŠČ╚Ė·█Öł¾ĖµŻ¼2025─ĻĄ┌Č■╝ŠČ╚ĪĘ’@╩ŠŻ¼╔Ž░ļ─Ļ╚½Ū“ųŪ─▄╝ęŠėŪÕØŹÖC(j©®)Ų„╚╦╩ął÷│÷žø1,2╚f┼_Ż¼═¼▒╚į÷ķL33%Ż¼’@╩Š│÷ŲĘŅÉÅŖ(qi©óng)ä┼Ą─╩ął÷ąĶŪ¾ĪŻ